- ▸ Positionnement et tarification

- ▸ Performances mesurées

- ▸ Cas d'usage optimaux

- ▸ Dans le paysage concurrentiel

Positionnement et tarification

Google a lancé Gemini 3.1 Flash-Lite en preview début mars 2026, et le modèle s’impose rapidement comme la référence dans le segment des LLM économiques. La tarification est agressive : 0,25 dollar par million de tokens en entrée et 1,50 dollar par million de tokens en sortie. À titre de comparaison, c’est huit fois moins cher que Gemini Pro sur le même volume.

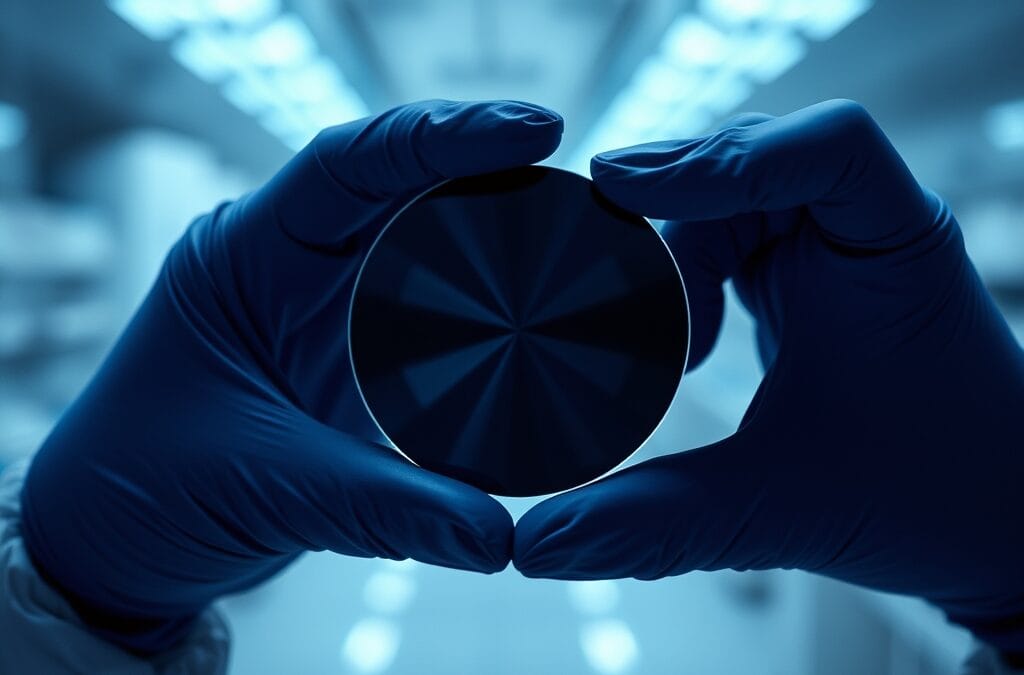

Le modèle accepte du texte, des images, de l’audio et de la vidéo en entrée, avec une fenêtre de contexte d’un million de tokens — un atout majeur pour les applications nécessitant le traitement de documents longs ou de conversations étendues.

Performances mesurées

Les benchmarks indépendants d’Artificial Analysis confirment les promesses de Google. Flash-Lite affiche un temps de premier token 2,5 fois plus rapide que Gemini 2.5 Flash, et une vitesse de génération en sortie supérieure de 45 %. Sur le plan qualitatif, le modèle obtient un score Elo de 1432 sur le classement Arena.ai.

Les résultats sur les benchmarks académiques sont solides pour sa catégorie. Flash-Lite atteint 86,9 % sur GPQA Diamond (raisonnement scientifique avancé) et 76,8 % sur MMMU Pro (compréhension multimodale). Ces scores le placent au-dessus de la plupart des modèles de même gamme tarifaire.

Cas d’usage optimaux

Flash-Lite est conçu pour les développeurs qui gèrent de gros volumes de requêtes avec des contraintes de latence et de coût. Les cas d’usage typiques incluent le traitement de données en temps réel avec classification et extraction à grande échelle, les chatbots à fort trafic nécessitant des réponses rapides et peu coûteuses, le pré-traitement de documents avant envoi à un modèle plus puissant, et la modération automatique de contenu.

En revanche, pour des tâches nécessitant un raisonnement complexe en plusieurs étapes ou une génération créative de haut niveau, les modèles Gemini Pro ou Ultra restent plus adaptés. Flash-Lite n’est pas conçu pour remplacer le haut de gamme — il est conçu pour que le haut de gamme ne soit sollicité que quand c’est nécessaire.

Dans le paysage concurrentiel

Le marché des LLM économiques est devenu un champ de bataille à part entière. OpenAI propose GPT-4o-mini, Anthropic a Claude Haiku 4.5, et Mistral a ses modèles « Small ». Flash-Lite se distingue par la combinaison d’une fenêtre de contexte massive (1M tokens), d’une capacité multimodale native et d’un prix plancher.

La stratégie de Google est claire : rendre l’accès à l’IA si peu coûteux que les développeurs intègrent Gemini dans des workflows où le coût par requête était auparavant prohibitif. C’est un pari sur le volume plutôt que sur la marge — et avec la taille de l’écosystème Google Cloud, c’est un pari que peu de concurrents peuvent égaler.

Notre avis

Gemini 3.1 Flash-Lite tient ses promesses sur le rapport qualité-prix. La vitesse est réellement impressionnante en conditions réelles, et la fenêtre de contexte d’un million de tokens ouvre des possibilités que les modèles économiques concurrents ne couvrent pas encore. Le support multimodal natif (texte, image, audio, vidéo) évite de jongler entre plusieurs modèles spécialisés.

Le principal bémol est le plafond qualitatif : sur les tâches de raisonnement complexe, la différence avec Pro est perceptible. Flash-Lite reste un modèle de volume, pas un modèle de précision maximale. Mais dans son créneau — du traitement rapide, fiable et peu coûteux à grande échelle — il fixe un nouveau standard.