- ▸ Une publication discrète qui rouvre un débat de fond

- ▸ La thèse : revenir au geste avant de revenir au prompt

- ▸ Contexte historique : d'Engelbart à la rupture conversationnelle

- ▸ Analyse technique : quatre principes et trois démos

Selon une publication de Google DeepMind datée du 12 mai 2026, le pointeur de souris — inchangé depuis le Stanford Research Institute de 1968 — fait l’objet d’une refonte conceptuelle pour devenir l’interface centrale entre l’utilisateur et les modèles génératifs. Pendant que l’industrie poursuit le mirage de l’agent autonome, le laboratoire d’Alphabet revient à un constat plus terre-à-terre : la flèche que vous déplacez depuis trois décennies est sous-exploitée. Quatre principes structurent cette refonte, trois démos en éprouvent la grammaire, et la chaîne de valeur du logiciel grand public pourrait s’en trouver remodelée.

Points clés 1. DeepMind publie le 12 mai 2026 un cadre de réflexion qui repositionne le pointeur comme couche d’interaction avec l’IA, alors que le périphérique a peu évolué en plus d’un demi-siècle. 2. Quatre principes structurent le travail : maintenir le flux, montrer et dire, contextualiser l’intention, intégrer l’IA dans les outils existants plutôt que dans des chatbots séparés. 3. Les démos couvrent l’édition d’image en place et l’exploration cartographique, et s’appuient sur Gemini et Google AI Studio. 4. L’enjeu industriel : court-circuiter la friction du prompt textuel long, identifiée par DeepMind comme contre-intuitive au comportement humain naturel. 5. La concurrence — Apple, Microsoft, Adobe, Anthropic — explore des trajectoires divergentes, du curseur génératif au copilote conversationnel, sans converger sur un standard.

Une publication discrète qui rouvre un débat de fond

Le 12 mai 2026, Google DeepMind met en ligne un billet sobre, intitulé Shaping the future of AI interaction by reimagining the mouse pointer. Pas d’annonce produit, pas de prix, pas de date de sortie : un texte qui s’apparente davantage à un manifeste de design qu’à une feuille de route commerciale. Le laboratoire britannique, racheté par Google en 2014 et fusionné avec Google Brain en avril 2023, prend la parole sur un objet auquel la recherche en interaction homme-machine n’avait pas consacré de réflexion majeure depuis des années. La forme — un billet de blog d’équipe — contraste avec la portée de la question posée : à quoi ressemblera, demain, le geste de manipuler un ordinateur ?

La thèse : revenir au geste avant de revenir au prompt

DeepMind défend une idée simple. Les interfaces conversationnelles, en imposant le texte long comme mode d’entrée privilégié, ont introduit une friction que l’industrie sous-estime. « In everyday interactions with each other, humans rarely speak in long, detailed paragraphs. We might say… », écrit le laboratoire pour rappeler que l’humain s’exprime souvent par déictiques — ceci, cela, ici, là — accompagnés d’un geste. Le pointeur, depuis 1968, code précisément ce geste. Le réhabiliter, c’est restituer à l’IA un canal d’entrée que les chatbots ont éclipsé.

Contexte historique : d’Engelbart à la rupture conversationnelle

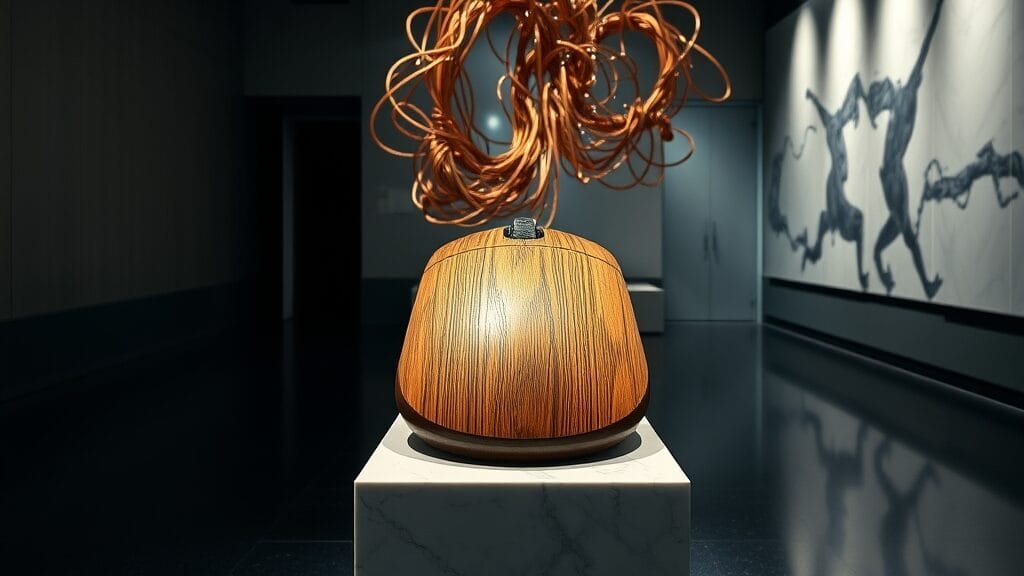

Le pointeur de souris est le produit d’une généalogie longue, dont la rupture la plus visible reste la Mother of All Demos du 9 décembre 1968. Ce jour-là, Douglas Engelbart présente devant 1 000 personnes au Convention Center de San Francisco un dispositif qu’aucun spectateur n’a jamais vu : une boîte de bois équipée de deux disques, dont le déplacement contrôle une flèche affichée à l’écran. La démonstration agrège des concepts qui structureront ensuite l’informatique grand public — hypertexte, édition collaborative, vidéoconférence. La souris en sort comme un détail. Elle deviendra l’élément le plus durable.

Xerox PARC, puis Apple avec la Lisa en 1983 et le Macintosh en janvier 1984, industrialisent le couple souris-fenêtres. Microsoft consolide le standard avec Windows à partir de 1985. La grammaire — clic gauche pour sélectionner, clic droit pour contextualiser, double-clic pour activer, glisser-déposer pour déplacer — s’est figée à la fin des années 1990. Trente ans plus tard, elle reste inchangée sur la quasi-totalité des systèmes d’exploitation desktop.

Cette stabilité a une conséquence rarement explicitée. Les ordinateurs ont, depuis l’iPhone de 2007, intégré des canaux d’entrée nouveaux : tactile multipoint, voix, capteurs inertiels, biométrie. La souris, elle, n’a reçu aucune extension fonctionnelle d’envergure depuis la molette de défilement, popularisée par Microsoft avec l’IntelliMouse en 1996. Le périphérique a accumulé du capital culturel — chaque utilisateur sait l’utiliser — sans gagner en expressivité.

L’arrivée des grands modèles de langage à partir de novembre 2022 a, paradoxalement, accentué l’écart. L’interface conversationnelle a imposé le champ de texte comme canal d’interaction privilégié avec l’IA. Le pointeur, lui, est resté cantonné aux opérations classiques. C’est ce déséquilibre que DeepMind propose de corriger.

Analyse technique : quatre principes et trois démos

Le billet du 12 mai 2026 organise sa proposition autour de quatre principes d’interaction. Ils sont énoncés comme un cadre de conception et non comme une spécification produit. Le tableau suivant les met en regard du paradigme actuel.

| Principe DeepMind | Pratique actuelle dominante | Conséquence concrète |

|---|---|---|

| Maintenir le flux | L’utilisateur quitte l’outil pour ouvrir un chatbot | L’IA s’invoque dans l’application active, sans rupture |

| Montrer et dire | Tout passe par le prompt écrit | Le pointeur désigne, la voix ou la frappe complètent |

| Contextualiser l’intention | Le modèle ne sait pas où regarde l’utilisateur | La position du curseur informe la requête |

| Intégrer plutôt que séparer | Chatbots cloisonnés dans des onglets distincts | Capacités IA tissées dans les outils existants |

Le premier principe — maintenir le flux — s’attaque à un coût cognitif souvent négligé : l’interruption. Selon les travaux fondateurs de Gloria Mark, professeure à l’Université de Californie à Irvine et autrice de Attention Span (Hanover Square Press, 2023), il faut en moyenne 23 minutes pour retrouver une concentration profonde après une interruption. Quitter Photoshop pour formuler une requête dans un chatbot, copier la réponse, revenir à l’outil : la séquence brise le flux. DeepMind propose de faire émerger l’IA dans le contexte exact où elle est invoquée.

Le deuxième principe — montrer et dire — formalise l’idée que le pointeur peut suppléer une partie du prompt textuel. Si je désigne un objet dans une image, je n’ai plus besoin de le décrire. Le geste devient une compression sémantique. Le laboratoire reprend explicitement la grammaire des déictiques humains : fais ceci avec cela, où ceci et cela sont portés par la position du curseur.

Le troisième principe — contextualiser l’intention — découle du précédent. La trajectoire du pointeur, le temps passé sur une zone, les éléments survolés sont autant de signaux d’intention que les modèles peuvent exploiter. Le pointeur cesse d’être un simple sélecteur pour devenir un capteur d’attention.

Le quatrième principe — intégrer plutôt que séparer — tranche avec la stratégie dominante des laboratoires concurrents. Plutôt que de pousser un produit autonome — un chatbot vertical, un agent dédié — DeepMind défend l’enrichissement des outils déjà installés. La logique inverse celle d’OpenAI, dont ChatGPT a captur » 800 millions d’utilisateurs hebdomadaires selon les déclarations de Sam Altman en mars 2026, en faisant l’application autonome dominante du secteur.

Trois démos illustrent le cadre. La première porte sur l’édition d’image : l’utilisateur désigne un élément dans une scène et indique vocalement ou par texte court ce qu’il faut en faire. La deuxième concerne la recherche cartographique : le pointeur survole une zone, et le système propose des lieux pertinents sans qu’une requête formelle soit saisie. La troisième relève de l’exploration de documents, où le curseur déclenche des résumés ou des reformulations contextuelles. Les démos s’appuient sur Gemini, la famille de modèles de Google DeepMind dont la version 2.5 Pro est sortie en mars 2025, et Google AI Studio, l’environnement de prototypage destiné aux développeurs.

Le choix de Gemini n’est pas anodin. Le modèle multimodal natif gère nativement l’image, le texte et l’audio, ce qui rend la combinaison pointeur + voix + image techniquement viable sans pipeline de conversion intermédiaire. Le pointeur, dans ce schéma, devient une coordonnée — un (x, y) horodaté — injectée directement dans le contexte du modèle.

Chiffre-phare : 58 ans. C’est l’âge de la souris de Douglas Engelbart, présentée en 1968. Aucune évolution fonctionnelle majeure depuis la molette IntelliMouse de Microsoft en 1996, soit 30 ans de stagnation.

Impact terrain : un déplacement de la chaîne de valeur logicielle

Si la proposition de DeepMind se diffuse, l’impact se mesurera moins dans les ventes de souris que dans la structuration du marché logiciel. Trois conséquences sont identifiables à partir des sources disponibles à ce jour.

Première conséquence : un avantage aux éditeurs intégrés. Les applications qui contrôlent à la fois le curseur et le contexte — suites bureautiques, éditeurs créatifs, environnements de développement — sont mieux positionnées pour intégrer l’interaction montrer et dire que les chatbots autonomes. Microsoft, qui pilote Office, Windows et l’éditeur de code Visual Studio Code, dispose d’un avantage structurel. Adobe, dont la suite Creative Cloud domine le marché des outils visuels, occupe une position comparable sur le verticale de la création.

Deuxième conséquence : une redistribution potentielle de la valeur entre couche modèle et couche application. Si le pointeur devient un canal d’entrée du modèle, le rendu de l’expérience utilisateur ne dépend plus seulement de la qualité du LLM, mais aussi de la finesse de l’intégration logicielle. Les développeurs d’applications retrouvent un terrain de différenciation que la course aux paramètres avait érodé.

Troisième conséquence : un défi pour les agents autonomes. Les agents — programmes qui exécutent des tâches en pilotant eux-mêmes un navigateur ou un système d’exploitation — partent du principe que l’humain délègue. L’approche DeepMind, à l’inverse, augmente l’humain qui reste aux commandes. Les deux trajectoires ne sont pas exclusives, mais elles répondent à des hypothèses opposées sur ce que les utilisateurs souhaitent : un copilote silencieux ou un exécutant détaché.

Pour les directions techniques en France, la question pratique est immédiate. Une équipe qui prépare une migration vers un assistant interne doit-elle parier sur l’intégration en place (chemin DeepMind) ou sur un chatbot d’entreprise (chemin OpenAI, Anthropic dans une certaine mesure) ? La réponse dépend du profil de l’utilisateur final. Pour un analyste financier ou un graphiste, l’intégration en place réduit les ruptures. Pour un support client, le chatbot reste plus efficace.

Perspectives contradictoires : un consensus loin d’être acquis

La proposition de DeepMind n’est pas la seule trajectoire de réinvention de l’interface. Plusieurs voix la nuancent.

Premier contre-argument : le pointeur est un héritage du desktop, donc d’une part décroissante des usages. Selon StatCounter, en avril 2026, les terminaux mobiles représentent près de 60 % du trafic Web mondial, contre 40 % pour les desktops, écart à peu près stable depuis 2023. Réinvestir un objet du clavier-souris pourrait paraître contre-intuitif au moment où la majorité des interactions se font au doigt. À cela, les défenseurs de la proposition répondent que les usages professionnels — création, ingénierie, finance, analyse — restent largement desktop, et que c’est précisément là que les LLM peinent à s’intégrer naturellement.

Deuxième contre-argument : la voix pourrait constituer un canal d’entrée plus universel et plus inclusif. Apple, avec les évolutions de Siri annoncées en juin 2024 lors de la WWDC sous la bannière Apple Intelligence, a fait le pari d’une voix intégrée au système. Amazon, avec la refonte d’Alexa en Alexa+ présentée en février 2025, vise la même cible. Le pointeur conserve toutefois deux avantages : la précision spatiale, qu’aucune voix ne peut égaler, et la discrétion, qu’une commande vocale n’offre pas dans un open space.

Troisième contre-argument : l’intégration profonde dans les applications soulève des questions de gouvernance des données. Si le pointeur informe le modèle de ce que regarde l’utilisateur, qu’advient-il de la confidentialité ? La position d’un curseur dans un tableur peut révéler une stratégie commerciale, une trajectoire de carrière, un projet de M&A. Aucune réponse définitive n’est apportée par le billet de DeepMind, qui se concentre sur la grammaire d’interaction. Les sources disponibles à ce jour ne précisent pas le périmètre des données remontées vers les serveurs de Google.

Quatrième contre-argument : la fragmentation des standards. Si chaque éditeur — Microsoft, Adobe, Apple, Google — développe sa propre grammaire de pointeur augmenté, l’utilisateur risque de devoir réapprendre des micro-conventions différentes selon l’application. La force du pointeur, depuis 1968, est précisément son universalité. Cette universalité pourrait être la première victime de la refonte.

Prospective : trois scénarios pour les dix-huit prochains mois

La proposition de DeepMind est un cadre de conception, pas un produit fini. Sa trajectoire dépendra d’au moins trois variables : l’adoption par les développeurs tiers via Google AI Studio, la réaction des concurrents — Microsoft, Apple, Adobe, Anthropic — et la capacité des intégrations à survivre au test du grand public.

Scénario 1 — Convergence rapide. Les principes énoncés par DeepMind sont repris dans les outils Microsoft 365 et Adobe Creative Cloud avant fin 2026, sous des noms différents. Le pointeur augmenté devient une commodité de l’expérience utilisateur, comme le glisser-déposer dans les années 1990.

Scénario 2 — Fragmentation. Chaque éditeur développe sa propre interprétation. L’utilisateur jongle entre des grammaires différentes. La promesse d’unification portée par le billet de DeepMind échoue, et l’interface conversationnelle textuelle reste le canal dominant.

Scénario 3 — Effacement progressif. La voix, le tactile et, à plus long terme, les interfaces neuronales — Neuralink a obtenu en mai 2023 l’autorisation de la FDA pour des essais humains — rendent le pointeur obsolète avant qu’il n’ait eu le temps de se réinventer. La proposition de DeepMind serait alors la dernière contribution majeure à un paradigme en voie de disparition.

Aucun des trois scénarios n’est aujourd’hui dominant. La question qui reste ouverte est de savoir si les utilisateurs adopteront un geste qui rompt avec trente ans d’habitudes. L’histoire de l’informatique grand public montre que les habitudes pèsent davantage que les promesses techniques. Et c’est sans doute là, plus que dans les principes énoncés, que se jouera le sort de cette réinvention.

FAQ

En quoi le pointeur de DeepMind diffère-t-il d’un chatbot classique ?

Le projet déplace l’interaction du champ de texte vers le geste. Au lieu de décrire un objet à modifier dans un long prompt, l’utilisateur le désigne avec le curseur et complète par une consigne courte. L’IA s’invoque dans l’application active, sans rupture vers un onglet séparé.

Quels sont les quatre principes énoncés par DeepMind ?

Maintenir le flux de travail dans l’application active, montrer et dire en combinant geste et parole, contextualiser l’intention via la position du curseur, et intégrer les capacités d’IA dans les outils existants plutôt que dans des chatbots autonomes. Ces principes guident la conception sans imposer un produit unique.

Sur quelles technologies repose le prototype ?

Les démos s’appuient sur Gemini, la famille de modèles multimodaux de Google DeepMind, et sur Google AI Studio, l’environnement de prototypage destiné aux développeurs. Le caractère nativement multimodal de Gemini facilite la combinaison pointeur, voix et image dans un même contexte.

Le pointeur traditionnel va-t-il disparaître ?

Rien dans la publication ne suggère un remplacement du pointeur classique. Il s’agit d’une extension fonctionnelle : les usages historiques — cliquer, glisser, sélectionner — restent identiques. C’est la couche d’interaction avec l’IA qui s’ajoute par-dessus, sans supprimer les conventions issues de la Mother of All Demos de 1968.

Encadré sources

- Google DeepMind, Shaping the future of AI interaction by reimagining the mouse pointer, billet officiel publié le 12 mai 2026 : https://deepmind.google/blog/ai-pointer/

- Stanford Research Institute, archives de la Mother of All Demos du 9 décembre 1968, Doug Engelbart Institute.

- Gloria Mark, Attention Span, Hanover Square Press, 2023, données sur le coût cognitif des interruptions.

- StatCounter Global Stats, parts de marché desktop/mobile, données accessibles avril 2026.

- Apple WWDC 2024, présentation d’Apple Intelligence, juin 2024.

- Amazon, présentation d’Alexa+, février 2025.

- Sam Altman, déclarations publiques sur les usages hebdomadaires de ChatGPT, mars 2026.

- Anthropic et la course aux 1M de tokens — analyse LagazetteIA des stratégies d’intégration IA.

- Apple Intelligence : le pari de l’intégration système — comparatif LagazetteIA.

- Gemini 2.5 Pro : ce qui change pour les développeurs — analyse LagazetteIA.