- ▸ Une boutade entendue dans tous les salons d'orientation

- ▸ Thèse : l'orientation est devenue un exercice de confiance

- ▸ Contexte historique : trente ans d'arrière-plan technologique

- ▸ Analyse : trois lignes de fracture dans le filtre parental

Une phrase revient dans les conversations familiales quand l’orientation arrive sur la table : « Pourquoi pas pilote ? Je ne monterais pas dans un avion dont le pilote est une IA. » Derrière cette boutade se joue un arbitrage profond : celui des parents qui filtrent les métiers de leurs enfants à l’aune de la confiance qu’ils accordent à l’intelligence artificielle. Trois lignes de fracture, trois manières de penser le risque.

Points clés 1. Les parents érigent une barrière mentale entre les métiers où l’IA assiste et ceux où elle décide à la place de l’humain — le cockpit en est devenu le symbole. 2. L’orientation scolaire 2026 voit affluer les filières dites « IA-compatibles », mais les familles trient selon un critère implicite : la responsabilité finale reste-t-elle humaine ? 3. La méfiance parentale repose sur trois piliers : sécurité physique, chaîne de responsabilité juridique, fiabilité statistique perçue. 4. Les conseillers d’orientation décrivent un déplacement des vœux : moins de filières « augmentées par l’IA », plus de métiers « protégés par contact humain » (santé, éducation, artisanat). 5. La fracture n’est pas générationnelle au sens classique — elle traverse aussi les adolescents eux-mêmes, qui adoptent souvent la grille de lecture parentale.

Une boutade entendue dans tous les salons d’orientation

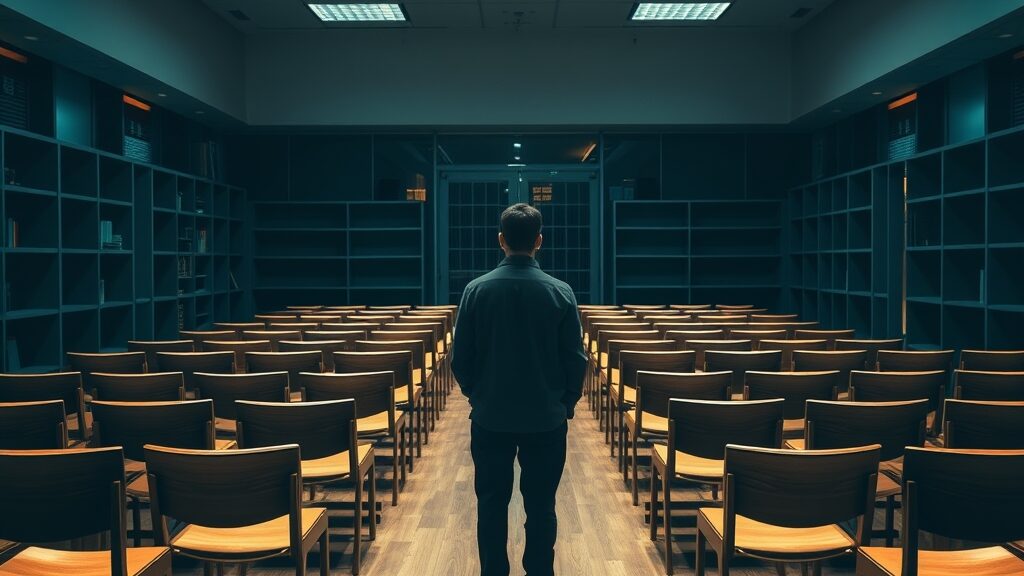

La scène se répète, presque mot pour mot, dans les rendez-vous d’orientation de printemps 2026. Un adolescent évoque une voie technique exigeante. Le parent acquiesce, hésite, puis lâche : « Pourquoi pas pilote ? Je ne monterais pas dans un avion dont le pilote est une IA. » C’est cette formule, recueillie par Le Monde dans son enquête publiée le 2 mai 2026, qui condense un climat d’époque.

La phrase fonctionne en deux temps. Elle ouvre le champ — pourquoi pas un métier prestigieux ? — puis elle le referme aussitôt, en posant une condition implicite : le métier doit rester humainement piloté. Le cockpit devient l’image-frontière entre les territoires où l’on accepte l’intelligence artificielle comme assistant et ceux où l’on refuse qu’elle prenne le manche.

Cette anecdote n’est pas un détail journalistique. Elle dit quelque chose des arbitrages familiaux qui se jouent en ce moment, à mesure que les outils génératifs et les systèmes décisionnels automatisés gagnent en visibilité dans la vie quotidienne et dans les imaginaires professionnels.

Thèse : l’orientation est devenue un exercice de confiance

L’orientation scolaire et professionnelle a longtemps été pensée comme une équation à trois inconnues : les goûts de l’élève, ses aptitudes, le marché du travail. À ces variables s’ajoute désormais une quatrième, plus souterraine : le degré de confiance que la famille accorde à l’IA dans le métier visé.

Ce filtre opère silencieusement. Il ne s’énonce pas dans les questionnaires de Parcoursup. Il se révèle dans les phrases anodines, comme celle rapportée par Le Monde. Et il redessine, sans débat collectif, la carte des aspirations professionnelles que les parents transmettent à leurs enfants.

Contexte historique : trente ans d’arrière-plan technologique

Pour comprendre pourquoi 2026 cristallise ces tensions, il faut remonter le fil long de la confiance public-machine. Dans les années 1990, l’arrivée du pilote automatique sur les vols commerciaux a déclenché une vague d’inquiétude similaire, vite dissipée par la statistique : la sécurité aérienne s’est améliorée, et la cohabitation pilote humain – système automatisé est devenue la norme acceptée.

Les années 2000 ont vu la même séquence se rejouer pour la finance, avec les algorithmes de trading haute fréquence. La défiance initiale a été absorbée par la spécialisation : un grand public lointain, des opérateurs experts au contact. Personne n’a eu à arbitrer, dans son salon, sur l’opportunité d’envoyer son enfant vers un métier de salle de marchés à cause des algorithmes.

Les années 2010 ont marqué une bascule. L’apprentissage automatique sort des laboratoires et entre dans les usages : recommandations, reconnaissance d’image, traduction. Les premiers véhicules autonomes circulent sur routes ouvertes en Californie. Le débat public s’installe, mais sur un mode hypothétique : la voiture sans chauffeur reste une promesse.

L’épisode des grands modèles de langage, à partir de 2022-2023, change la nature du débat. L’IA ne se contente plus d’optimiser en arrière-plan — elle rédige, conseille, code, dessine. Les familles découvrent ces outils par leurs enfants, et les enfants les découvrent par leurs camarades. La frontière entre travail intellectuel humain et production machine devient poreuse à l’œil nu.

C’est dans ce sédiment trentenaire que s’inscrit la question que pose Le Monde en mai 2026 : comment les parents conseillent-ils un avenir professionnel quand chaque métier semble, à des degrés divers, candidat à une refonte par l’IA ? La réponse intuitive — refuser le pilote IA, accepter l’IA assistante — est moins une position théorique qu’un héritage psychologique de ces décennies de cohabitation hésitante.

Analyse : trois lignes de fracture dans le filtre parental

Le filtre parental ne fonctionne pas en bloc. Il combine trois critères distincts, que l’enquête du Monde permet d’identifier en arrière-plan de la phrase emblématique sur le cockpit. Une grille comparative aide à lire le phénomène.

| Critère parental | Question implicite | Métiers acceptés sans réserve | Métiers filtrés voire refusés |

|---|---|---|---|

| Sécurité physique | « Si l’IA se trompe, quelqu’un meurt-il ? » | Métiers tertiaires sans risque vital direct | Pilote, chirurgien, conducteur de transport |

| Responsabilité juridique | « Qui est juridiquement responsable en cas de faute ? » | Métiers où l’humain signe et endosse | Métiers où la décision algorithmique fait foi |

| Fiabilité perçue | « L’IA fait-elle moins d’erreurs qu’un humain dans ce contexte ? » | Tâches répétitives à haut volume | Décisions singulières à fort enjeu |

Le premier critère, la sécurité physique, est le plus visible et le plus émotionnellement chargé. Il explique pourquoi le cockpit cristallise tant. Un pilote, c’est une vie entre deux mains — au sens propre. L’idée que cette vie dépende d’un système probabiliste, aussi rigoureux soit-il, déclenche un refus quasi viscéral chez les parents. Ce refus n’est pas pondéré par les statistiques de sécurité aérienne automatisée. Il fonctionne sur un autre registre, celui de l’agence morale.

Le deuxième critère, la responsabilité juridique, joue plus discrètement mais avec autant de force. Les parents perçoivent intuitivement que les chaînes de responsabilité fondées sur la décision humaine sont stables et lisibles, là où les chaînes mêlant automatisation et supervision humaine deviennent floues. Cette intuition rejoint un débat juridique en cours dans plusieurs pays sur la qualification des décisions assistées par IA, sans qu’aucune doctrine consolidée n’ait encore émergé selon les sources disponibles à ce jour.

Le troisième critère, la fiabilité perçue, est le plus paradoxal. Statistiquement, dans plusieurs domaines, des systèmes automatisés affichent déjà des performances supérieures à des opérateurs humains moyens. Mais la fiabilité perçue ne se mesure pas en taux d’erreur : elle se mesure en intelligibilité de l’erreur. Quand un humain se trompe, le récit de l’erreur est compréhensible — fatigue, distraction, jugement faillible. Quand une IA se trompe, l’erreur reste opaque, ou pire : statistiquement rare mais imprévisible.

Ces trois critères se combinent en un score implicite. Plus un métier accumule de points sur les trois axes, plus il est filtré dans les conversations familiales. À l’inverse, les métiers qui n’engagent ni sécurité physique ni responsabilité juridique ni décision singulière passent sans encombre — quand bien même l’IA y serait massivement utilisée.

Un chiffre-phare manque pour cartographier précisément l’ampleur du phénomène : les enquêtes nationales sur l’arbitrage parental face à l’IA dans l’orientation restent à construire. La phrase rapportée par Le Monde tient lieu, faute de mieux, de marqueur qualitatif. Elle a la vertu d’être citable, transposable, mémorable — c’est pour cela qu’elle circule.

Impact terrain : ce que les conseillers d’orientation observent

Sur le terrain, les conseillers d’orientation sont les premiers récepteurs du phénomène. Leur position d’interface entre famille, élève et établissement leur donne accès à une matière brute que les statistiques ne capturent pas encore. Plusieurs lignes de tension émergent.

La première tient à la dissociation entre la posture publique de l’élève et la posture familiale. Un adolescent peut se déclarer enthousiaste face à une carrière dans l’aéronautique ou la chirurgie pendant un atelier collectif, puis revenir, après échange à la maison, avec un projet recadré vers une voie « moins exposée à l’IA ». Le filtre parental opère hors les murs de l’établissement, en différé, et redirige les vœux sans toujours s’expliciter dans le dialogue avec le conseiller.

La deuxième tension vient de l’asymétrie d’information. Les parents conseillent à partir d’une représentation des métiers parfois ancienne, nourrie par leur propre expérience professionnelle. Or l’introduction de l’IA dans un métier ne suit pas une logique linéaire. Certains métiers que l’on imagine très exposés — comptabilité, traduction, journalisme — restent encadrés par des dispositifs humains de validation. Inversement, certains métiers manuels que l’on imagine protégés voient apparaître des outils d’aide à la décision qui modifient le quotidien.

La troisième tension est générationnelle, mais à rebours de l’attendu. On pourrait anticiper un clivage où les jeunes embrasseraient l’IA et les parents la repousseraient. La réalité observée est plus nuancée. De nombreux adolescents adoptent la grille de lecture parentale, parfois en l’amplifiant. Ils intègrent eux-mêmes le critère « ce métier sera-t-il piloté par une IA ? » comme un critère de tri, et arbitrent en conséquence.

Cette intériorisation a une conséquence pratique : les filières supposées « refuges » — santé, enseignement, métiers de soin, artisanat — voient leur attractivité renforcée par un argument inattendu, celui de la non-substituabilité par l’IA. À l’inverse, certaines filières techniques fortement liées au développement de systèmes intelligents pourraient peiner à recruter, non par manque de candidats compétents mais par autocensure familiale en amont du choix.

Reste l’effet de classe. La capacité d’une famille à orienter son enfant en fonction de représentations fines du marché du travail dépend de son capital culturel et informationnel. Les familles les mieux dotées peuvent affiner leur filtre, voire le retourner — orientant vers les métiers qui conçoivent les IA plutôt que vers ceux qui les subissent. Les familles moins dotées risquent d’appliquer le filtre brut, en évitant indistinctement tout ce qui touche à l’IA, et en privant leurs enfants des secteurs en construction.

Perspectives contradictoires : l’autre lecture du phénomène

Le récit dominant — celui d’une méfiance parentale légitime face à une IA encore immature — n’épuise pas la question. Plusieurs lectures alternatives méritent d’être posées sur la table.

Première contradiction : la méfiance parentale ne traduit pas nécessairement une réalité technique du risque. Sur le cas emblématique du cockpit, l’aviation civile commerciale est, depuis des décennies, l’un des modes de transport les plus sûrs au monde, précisément parce qu’elle conjugue automatisation poussée et supervision humaine continue. Refuser un avion piloté par une IA au nom de la sécurité repose donc sur une intuition davantage que sur une analyse de risque comparée.

Deuxième contradiction : le filtre parental peut produire des effets contre-productifs. En détournant les meilleurs élèves des filières où l’IA prend une place croissante, il prive ces secteurs d’une diversité de profils qui serait précisément utile pour en orienter le développement. Une partie des chercheurs en éthique de l’IA défendent l’idée inverse — il faut envoyer plus, pas moins, de talents formés dans les métiers où l’IA décide, pour que la supervision humaine soit qualifiée et plurielle.

Troisième contradiction : la grille « IA décideur vs IA assistante » est elle-même fragile. La frontière entre les deux est mouvante. Un outil d’aide à la décision peut, par effet de routine et de surcharge cognitive, glisser vers une décision automatique de fait, même si le cadre formel maintient un humain dans la boucle. Inversement, un système présenté comme autonome reste souvent encadré par des opérateurs humains à des étapes invisibles. Le filtre parental binaire risque de mal capturer cette réalité graduelle.

Quatrième contradiction : la phrase « je ne monterais pas dans un avion dont le pilote est une IA » est une projection de soi, pas un conseil d’orientation rigoureux. Elle dit ce que le parent ferait à la place du passager, pas ce qu’il pense du métier de pilote ni de l’avenir professionnel de son enfant. Ce glissement entre posture de consommateur et posture de prescripteur d’orientation mérite d’être interrogé.

Ces contradictions ne disqualifient pas la méfiance parentale. Elles invitent à la nuancer. L’orientation est un exercice de pari sur l’avenir : le filtre IA, comme les autres filtres, mérite d’être explicité plutôt que d’opérer en sourdine.

Prospective : trois scénarios pour l’orientation 2026-2030

Trois scénarios se dessinent pour les prochaines années, en fonction de la trajectoire que prendront simultanément les capacités techniques de l’IA et les régulations qui les encadrent.

Premier scénario : la consolidation du filtre. Les parents continuent d’opérer le tri implicite, les filières « protégées » voient leurs candidatures s’envoler, les filières « exposées » se reconfigurent autour d’une promesse de contrôle humain renforcé. Les conseillers d’orientation intègrent explicitement la dimension IA dans leurs entretiens, en aidant les familles à expliciter leurs filtres.

Deuxième scénario : la dissolution progressive du filtre. À mesure que l’IA s’installe partout, le critère « ce métier sera-t-il piloté par une IA » perd de sa pertinence, parce qu’il devient trivialement vrai pour la quasi-totalité des métiers. Les familles renoncent au tri par exposition, et basculent vers d’autres critères — sens, conditions de travail, rémunération.

Troisième scénario : la fracture par catégorie sociale. Le filtre persiste mais se segmente. Les familles informées orientent vers les métiers de conception et de gouvernance de l’IA. Les familles moins informées s’en éloignent globalement. Une nouvelle inégalité d’orientation se construit, indexée sur la lecture qu’on fait du paysage IA.

La phrase rapportée par Le Monde — « pourquoi pas pilote ? » — restera-t-elle un témoignage daté de 2026, ou deviendra-t-elle le marqueur d’une recomposition durable des aspirations professionnelles ? Le suivi des cohortes Parcoursup et des choix d’apprentissage dans les prochaines années permettra de trancher.

FAQ

Pourquoi les parents refusent-ils l’idée d’un pilote IA ?

Le refus combine trois inquiétudes qui s’additionnent : la sécurité physique des passagers, la flou de la chaîne de responsabilité juridique en cas d’incident, et une fiabilité perçue qui dépend moins du taux d’erreur statistique que de l’intelligibilité de l’erreur. La phrase rapportée par Le Monde en mai 2026 cristallise ces trois dimensions en une formule mémorable, sans qu’aucune ne soit individuellement décisive.

L’orientation 2026 prend-elle en compte ces réticences ?

Sur le terrain, les conseillers d’orientation observent un déplacement des vœux vers les filières dites « non substituables » par l’IA — santé, soin, éducation, artisanat — et un certain évitement des secteurs perçus comme exposés. Aucune statistique nationale consolidée ne mesure encore l’ampleur du phénomène à ce jour, mais le signal qualitatif converge dans les retours d’établissements.

Quels métiers liés à l’IA gagnent en visibilité dans les conseils d’orientation ?

Les métiers présentés aux familles comme « IA-compatibles » sans relever du filtre parental le plus restrictif sont ceux où l’humain conserve une décision finale clairement identifiable : conception de systèmes, audit, gouvernance, traduction supervisée, médiation entre l’IA et ses utilisateurs. Ces fonctions se multiplient mais restent peu lisibles pour les familles non familières du secteur, ce qui constitue un enjeu pédagogique majeur.

Cette méfiance parentale est-elle justifiée par les faits ?

La méfiance parentale est une intuition, pas une mesure. Elle est légitime au sens où elle exprime une demande de contrôle humain sur les décisions à fort enjeu. Elle est contestable quand elle s’oppose à des données de sécurité documentées dans certains domaines, comme l’aviation automatisée. Le débat public manque encore d’instances où ces intuitions et ces données peuvent être confrontées sereinement, hors urgence d’arbitrage familial.

Sources – Le Monde, « Les conseils en orientation des parents à l’heure de l’intelligence artificielle : « Pourquoi pas pilote ? Je ne monterais pas dans un avion dont le pilote est une IA » », 2 mai 2026 — lien – Voir également notre dossier IA et marché du travail : où se déplacent les compétences et notre analyse Métiers protégés, métiers exposés : la nouvelle carte 2026.